- 8.2 合并数据集

- 数据库风格的DataFrame合并

- 索引上的合并

- 轴向连接

- 合并重叠数据

8.2 合并数据集

pandas对象中的数据可以通过一些方式进行合并:

- pandas.merge可根据一个或多个键将不同DataFrame中的行连接起来。SQL或其他关系型数据库的用户对此应该会比较熟悉,因为它实现的就是数据库的join操作。

- pandas.concat可以沿着一条轴将多个对象堆叠到一起。

- 实例方法combine_first可以将重复数据拼接在一起,用一个对象中的值填充另一个对象中的缺失值。

我将分别对它们进行讲解,并给出一些例子。本书剩余部分的示例中将经常用到它们。

数据库风格的DataFrame合并

数据集的合并(merge)或连接(join)运算是通过一个或多个键将行连接起来的。这些运算是关系型数据库(基于SQL)的核心。pandas的merge函数是对数据应用这些算法的主要切入点。

以一个简单的例子开始:

In [35]: df1 = pd.DataFrame({'key': ['b', 'b', 'a', 'c', 'a', 'a', 'b'],....: 'data1': range(7)})In [36]: df2 = pd.DataFrame({'key': ['a', 'b', 'd'],....: 'data2': range(3)})In [37]: df1Out[37]:data1 key0 0 b1 1 b2 2 a3 3 c4 4 a5 5 a6 6 bIn [38]: df2Out[38]:data2 key0 0 a1 1 b2 2 d

这是一种多对一的合并。df1中的数据有多个被标记为a和b的行,而df2中key列的每个值则仅对应一行。对这些对象调用merge即可得到:

In [39]: pd.merge(df1, df2)Out[39]:data1 key data20 0 b 11 1 b 12 6 b 13 2 a 04 4 a 05 5 a 0

注意,我并没有指明要用哪个列进行连接。如果没有指定,merge就会将重叠列的列名当做键。不过,最好明确指定一下:

In [40]: pd.merge(df1, df2, on='key')Out[40]:data1 key data20 0 b 11 1 b 12 6 b 13 2 a 04 4 a 05 5 a 0

如果两个对象的列名不同,也可以分别进行指定:

In [41]: df3 = pd.DataFrame({'lkey': ['b', 'b', 'a', 'c', 'a', 'a', 'b'],....: 'data1': range(7)})In [42]: df4 = pd.DataFrame({'rkey': ['a', 'b', 'd'],....: 'data2': range(3)})In [43]: pd.merge(df3, df4, left_on='lkey', right_on='rkey')Out[43]:data1 lkey data2 rkey0 0 b 1 b1 1 b 1 b2 6 b 1 b3 2 a 0 a4 4 a 0 a5 5 a 0 a

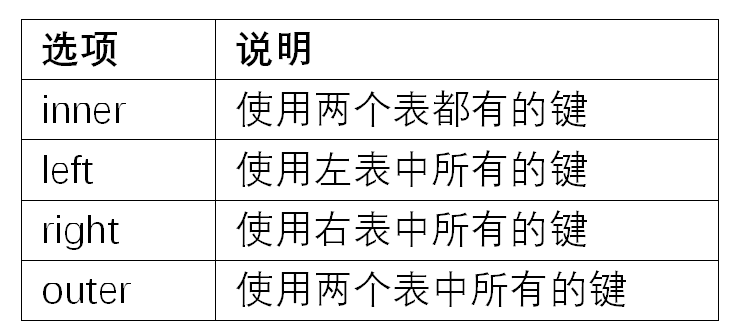

可能你已经注意到了,结果里面c和d以及与之相关的数据消失了。默认情况下,merge做的是“内连接”;结果中的键是交集。其他方式还有”left”、”right”以及”outer”。外连接求取的是键的并集,组合了左连接和右连接的效果:

In [44]: pd.merge(df1, df2, how='outer')Out[44]:data1 key data20 0.0 b 1.01 1.0 b 1.02 6.0 b 1.03 2.0 a 0.04 4.0 a 0.05 5.0 a 0.06 3.0 c NaN7 NaN d 2.0

表8-1对这些选项进行了总结。

多对多的合并有些不直观。看下面的例子:

In [45]: df1 = pd.DataFrame({'key': ['b', 'b', 'a', 'c', 'a', 'b'],....: 'data1': range(6)})In [46]: df2 = pd.DataFrame({'key': ['a', 'b', 'a', 'b', 'd'],....: 'data2': range(5)})In [47]: df1Out[47]:data1 key0 0 b1 1 b2 2 a3 3 c4 4 a5 5 bIn [48]: df2Out[48]:data2 key0 0 a1 1 b2 2 a3 3 b4 4 dIn [49]: pd.merge(df1, df2, on='key', how='left')Out[49]:data1 key data20 0 b 1.01 0 b 3.02 1 b 1.03 1 b 3.04 2 a 0.05 2 a 2.06 3 c NaN7 4 a 0.08 4 a 2.09 5 b 1.010 5 b 3.0

多对多连接产生的是行的笛卡尔积。由于左边的DataFrame有3个”b”行,右边的有2个,所以最终结果中就有6个”b”行。连接方式只影响出现在结果中的不同的键的值:

In [50]: pd.merge(df1, df2, how='inner')Out[50]:data1 key data20 0 b 11 0 b 32 1 b 13 1 b 34 5 b 15 5 b 36 2 a 07 2 a 28 4 a 09 4 a 2

要根据多个键进行合并,传入一个由列名组成的列表即可:

In [51]: left = pd.DataFrame({'key1': ['foo', 'foo', 'bar'],....: 'key2': ['one', 'two', 'one'],....: 'lval': [1, 2, 3]})In [52]: right = pd.DataFrame({'key1': ['foo', 'foo', 'bar', 'bar'],....: 'key2': ['one', 'one', 'one', 'two'],....: 'rval': [4, 5, 6, 7]})In [53]: pd.merge(left, right, on=['key1', 'key2'], how='outer')Out[53]:key1 key2 lval rval0 foo one 1.0 4.01 foo one 1.0 5.02 foo two 2.0 NaN3 bar one 3.0 6.04 bar two NaN 7.0

结果中会出现哪些键组合取决于所选的合并方式,你可以这样来理解:多个键形成一系列元组,并将其当做单个连接键(当然,实际上并不是这么回事)。

注意:在进行列-列连接时,DataFrame对象中的索引会被丢弃。

对于合并运算需要考虑的最后一个问题是对重复列名的处理。虽然你可以手工处理列名重叠的问题(查看前面介绍的重命名轴标签),但merge有一个更实用的suffixes选项,用于指定附加到左右两个DataFrame对象的重叠列名上的字符串:

In [54]: pd.merge(left, right, on='key1')Out[54]:key1 key2_x lval key2_y rval0 foo one 1 one 41 foo one 1 one 52 foo two 2 one 43 foo two 2 one 54 bar one 3 one 65 bar one 3 two 7In [55]: pd.merge(left, right, on='key1', suffixes=('_left', '_right'))Out[55]:key1 key2_left lval key2_right rval0 foo one 1 one 41 foo one 1 one 52 foo two 2 one 43 foo two 2 one 54 bar one 3 one 65 bar one 3 two 7

merge的参数请参见表8-2。使用DataFrame的行索引合并是下一节的主题。

表8-2 merge函数的参数

indicator 添加特殊的列_merge,它可以指明每个行的来源,它的值有left_only、right_only或both,根据每行的合并数据的来源。

索引上的合并

有时候,DataFrame中的连接键位于其索引中。在这种情况下,你可以传入left_index=True或right_index=True(或两个都传)以说明索引应该被用作连接键:

In [56]: left1 = pd.DataFrame({'key': ['a', 'b', 'a', 'a', 'b', 'c'],....: 'value': range(6)})In [57]: right1 = pd.DataFrame({'group_val': [3.5, 7]}, index=['a', 'b'])In [58]: left1Out[58]:key value0 a 01 b 12 a 23 a 34 b 45 c 5In [59]: right1Out[59]:group_vala 3.5b 7.0In [60]: pd.merge(left1, right1, left_on='key', right_index=True)Out[60]:key value group_val0 a 0 3.52 a 2 3.53 a 3 3.51 b 1 7.04 b 4 7.0

由于默认的merge方法是求取连接键的交集,因此你可以通过外连接的方式得到它们的并集:

In [61]: pd.merge(left1, right1, left_on='key', right_index=True, how='outer')Out[61]:key value group_val0 a 0 3.52 a 2 3.53 a 3 3.51 b 1 7.04 b 4 7.05 c 5 NaN

对于层次化索引的数据,事情就有点复杂了,因为索引的合并默认是多键合并:

In [62]: lefth = pd.DataFrame({'key1': ['Ohio', 'Ohio', 'Ohio',....: 'Nevada', 'Nevada'],....: 'key2': [2000, 2001, 2002, 2001, 2002],....: 'data': np.arange(5.)})In [63]: righth = pd.DataFrame(np.arange(12).reshape((6, 2)),....: index=[['Nevada', 'Nevada', 'Ohio', 'Ohio',....: 'Ohio', 'Ohio'],....: [2001, 2000, 2000, 2000, 2001, 2002]],....: columns=['event1', 'event2'])In [64]: lefthOut[64]:data key1 key20 0.0 Ohio 20001 1.0 Ohio 20012 2.0 Ohio 20023 3.0 Nevada 20014 4.0 Nevada 2002In [65]: righthOut[65]:event1 event2Nevada 2001 0 12000 2 3Ohio 2000 4 52000 6 72001 8 92002 10 11

这种情况下,你必须以列表的形式指明用作合并键的多个列(注意用how=’outer’对重复索引值的处理):

In [66]: pd.merge(lefth, righth, left_on=['key1', 'key2'], right_index=True)Out[66]:data key1 key2 event1 event20 0.0 Ohio 2000 4 50 0.0 Ohio 2000 6 71 1.0 Ohio 2001 8 92 2.0 Ohio 2002 10 113 3.0 Nevada 2001 0 1In [67]: pd.merge(lefth, righth, left_on=['key1', 'key2'],....: right_index=True, how='outer')Out[67]:data key1 key2 event1 event20 0.0 Ohio 2000 4.0 5.00 0.0 Ohio 2000 6.0 7.01 1.0 Ohio 2001 8.0 9.02 2.0 Ohio 2002 10.0 11.03 3.0 Nevada 2001 0.0 1.04 4.0 Nevada 2002 NaN NaN4 NaN Nevada 2000 2.0 3.0

同时使用合并双方的索引也没问题:

In [68]: left2 = pd.DataFrame([[1., 2.], [3., 4.], [5., 6.]],....: index=['a', 'c', 'e'],....: columns=['Ohio', 'Nevada'])In [69]: right2 = pd.DataFrame([[7., 8.], [9., 10.], [11., 12.], [13, 14]],....: index=['b', 'c', 'd', 'e'],....: columns=['Missouri', 'Alabama'])In [70]: left2Out[70]:Ohio Nevadaa 1.0 2.0c 3.0 4.0e 5.0 6.0In [71]: right2Out[71]:Missouri Alabamab 7.0 8.0c 9.0 10.0d 11.0 12.0e 13.0 14.0In [72]: pd.merge(left2, right2, how='outer', left_index=True, right_index=True)Out[72]:Ohio Nevada Missouri Alabamaa 1.0 2.0 NaN NaNb NaN NaN 7.0 8.0c 3.0 4.0 9.0 10.0d NaN NaN 11.0 12.0e 5.0 6.0 13.0 14.0

DataFrame还有一个便捷的join实例方法,它能更为方便地实现按索引合并。它还可用于合并多个带有相同或相似索引的DataFrame对象,但要求没有重叠的列。在上面那个例子中,我们可以编写:

In [73]: left2.join(right2, how='outer')Out[73]:Ohio Nevada Missouri Alabamaa 1.0 2.0 NaN NaNb NaN NaN 7.0 8.0c 3.0 4.0 9.0 10.0d NaN NaN 11.0 12.0e 5.0 6.0 13.0 14.0

因为一些历史版本的遗留原因,DataFrame的join方法默认使用的是左连接,保留左边表的行索引。它还支持在调用的DataFrame的列上,连接传递的DataFrame索引:

In [74]: left1.join(right1, on='key')Out[74]:key value group_val0 a 0 3.51 b 1 7.02 a 2 3.53 a 3 3.54 b 4 7.05 c 5 NaN

最后,对于简单的索引合并,你还可以向join传入一组DataFrame,下一节会介绍更为通用的concat函数,也能实现此功能:

In [75]: another = pd.DataFrame([[7., 8.], [9., 10.], [11., 12.], [16., 17.]],....: index=['a', 'c', 'e', 'f'],....: columns=['New York','Oregon'])In [76]: anotherOut[76]:New York Oregona 7.0 8.0c 9.0 10.0e 11.0 12.0f 16.0 17.0In [77]: left2.join([right2, another])Out[77]:Ohio Nevada Missouri Alabama New York Oregona 1.0 2.0 NaN NaN 7.0 8.0c 3.0 4.0 9.0 10.0 9.0 10.0e 5.0 6.0 13.0 14.0 11.0 12.0In [78]: left2.join([right2, another], how='outer')Out[78]:Ohio Nevada Missouri Alabama New York Oregona 1.0 2.0 NaN NaN 7.0 8.0b NaN NaN 7.0 8.0 NaN NaNc 3.0 4.0 9.0 10.0 9.0 10.0d NaN NaN 11.0 12.0 NaN NaNe 5.0 6.0 13.0 14.0 11.0 12.0f NaN NaN NaN NaN 16.0 17.0

轴向连接

另一种数据合并运算也被称作连接(concatenation)、绑定(binding)或堆叠(stacking)。NumPy的concatenation函数可以用NumPy数组来做:

In [79]: arr = np.arange(12).reshape((3, 4))In [80]: arrOut[80]:array([[ 0, 1, 2, 3],[ 4, 5, 6, 7],[ 8, 9, 10, 11]])In [81]: np.concatenate([arr, arr], axis=1)Out[81]:array([[ 0, 1, 2, 3, 0, 1, 2, 3],[ 4, 5, 6, 7, 4, 5, 6, 7],[ 8, 9, 10, 11, 8, 9, 10, 11]])

对于pandas对象(如Series和DataFrame),带有标签的轴使你能够进一步推广数组的连接运算。具体点说,你还需要考虑以下这些东西:

- 如果对象在其它轴上的索引不同,我们应该合并这些轴的不同元素还是只使用交集?

- 连接的数据集是否需要在结果对象中可识别?

- 连接轴中保存的数据是否需要保留?许多情况下,DataFrame默认的整数标签最好在连接时删掉。

pandas的concat函数提供了一种能够解决这些问题的可靠方式。我将给出一些例子来讲解其使用方式。假设有三个没有重叠索引的Series:

In [82]: s1 = pd.Series([0, 1], index=['a', 'b'])In [83]: s2 = pd.Series([2, 3, 4], index=['c', 'd', 'e'])In [84]: s3 = pd.Series([5, 6], index=['f', 'g'])

对这些对象调用concat可以将值和索引粘合在一起:

In [85]: pd.concat([s1, s2, s3])Out[85]:a 0b 1c 2d 3e 4f 5g 6dtype: int64

默认情况下,concat是在axis=0上工作的,最终产生一个新的Series。如果传入axis=1,则结果就会变成一个DataFrame(axis=1是列):

In [86]: pd.concat([s1, s2, s3], axis=1)Out[86]:0 1 2a 0.0 NaN NaNb 1.0 NaN NaNc NaN 2.0 NaNd NaN 3.0 NaNe NaN 4.0 NaNf NaN NaN 5.0g NaN NaN 6.0

这种情况下,另外的轴上没有重叠,从索引的有序并集(外连接)上就可以看出来。传入join=’inner’即可得到它们的交集:

In [87]: s4 = pd.concat([s1, s3])In [88]: s4Out[88]:a 0b 1f 5g 6dtype: int64In [89]: pd.concat([s1, s4], axis=1)Out[89]:0 1a 0.0 0b 1.0 1f NaN 5g NaN 6In [90]: pd.concat([s1, s4], axis=1, join='inner')Out[90]:0 1a 0 0b 1 1

在这个例子中,f和g标签消失了,是因为使用的是join=’inner’选项。

你可以通过join_axes指定要在其它轴上使用的索引:

In [91]: pd.concat([s1, s4], axis=1, join_axes=[['a', 'c', 'b', 'e']])Out[91]:0 1a 0.0 0.0c NaN NaNb 1.0 1.0e NaN NaN

不过有个问题,参与连接的片段在结果中区分不开。假设你想要在连接轴上创建一个层次化索引。使用keys参数即可达到这个目的:

In [92]: result = pd.concat([s1, s1, s3], keys=['one','two', 'three'])In [93]: resultOut[93]:one a 0b 1two a 0b 1three f 5g 6dtype: int64In [94]: result.unstack()Out[94]:a b f gone 0.0 1.0 NaN NaNtwo 0.0 1.0 NaN NaNthree NaN NaN 5.0 6.0

如果沿着axis=1对Series进行合并,则keys就会成为DataFrame的列头:

In [95]: pd.concat([s1, s2, s3], axis=1, keys=['one','two', 'three'])Out[95]:one two threea 0.0 NaN NaNb 1.0 NaN NaNc NaN 2.0 NaNd NaN 3.0 NaNe NaN 4.0 NaNf NaN NaN 5.0g NaN NaN 6.0

同样的逻辑也适用于DataFrame对象:

In [96]: df1 = pd.DataFrame(np.arange(6).reshape(3, 2), index=['a', 'b', 'c'],....: columns=['one', 'two'])In [97]: df2 = pd.DataFrame(5 + np.arange(4).reshape(2, 2), index=['a', 'c'],....: columns=['three', 'four'])In [98]: df1Out[98]:one twoa 0 1b 2 3c 4 5In [99]: df2Out[99]:three foura 5 6c 7 8In [100]: pd.concat([df1, df2], axis=1, keys=['level1', 'level2'])Out[100]:level1 level2one two three foura 0 1 5.0 6.0b 2 3 NaN NaNc 4 5 7.0 8.0

如果传入的不是列表而是一个字典,则字典的键就会被当做keys选项的值:

In [101]: pd.concat({'level1': df1, 'level2': df2}, axis=1)Out[101]:level1 level2one two three foura 0 1 5.0 6.0b 2 3 NaN NaNc 4 5 7.0 8.0

此外还有两个用于管理层次化索引创建方式的参数(参见表8-3)。举个例子,我们可以用names参数命名创建的轴级别:

In [102]: pd.concat([df1, df2], axis=1, keys=['level1', 'level2'],.....: names=['upper', 'lower'])Out[102]:upper level1 level2lower one two three foura 0 1 5.0 6.0b 2 3 NaN NaNc 4 5 7.0 8.0

最后一个关于DataFrame的问题是,DataFrame的行索引不包含任何相关数据:

In [103]: df1 = pd.DataFrame(np.random.randn(3, 4), columns=['a', 'b', 'c', 'd'])In [104]: df2 = pd.DataFrame(np.random.randn(2, 3), columns=['b', 'd', 'a'])In [105]: df1Out[105]:a b c d0 1.246435 1.007189 -1.296221 0.2749921 0.228913 1.352917 0.886429 -2.0016372 -0.371843 1.669025 -0.438570 -0.539741In [106]: df2Out[106]:b d a0 0.476985 3.248944 -1.0212281 -0.577087 0.124121 0.302614

在这种情况下,传入ignore_index=True即可:

In [107]: pd.concat([df1, df2], ignore_index=True)Out[107]:a b c d0 1.246435 1.007189 -1.296221 0.2749921 0.228913 1.352917 0.886429 -2.0016372 -0.371843 1.669025 -0.438570 -0.5397413 -1.021228 0.476985 NaN 3.2489444 0.302614 -0.577087 NaN 0.124121

合并重叠数据

还有一种数据组合问题不能用简单的合并(merge)或连接(concatenation)运算来处理。比如说,你可能有索引全部或部分重叠的两个数据集。举个有启发性的例子,我们使用NumPy的where函数,它表示一种等价于面向数组的if-else:

In [108]: a = pd.Series([np.nan, 2.5, np.nan, 3.5, 4.5, np.nan],.....: index=['f', 'e', 'd', 'c', 'b', 'a'])In [109]: b = pd.Series(np.arange(len(a), dtype=np.float64),.....: index=['f', 'e', 'd', 'c', 'b', 'a'])In [110]: b[-1] = np.nanIn [111]: aOut[111]:f NaNe 2.5d NaNc 3.5b 4.5a NaNdtype: float64In [112]: bOut[112]:f 0.0e 1.0d 2.0c 3.0b 4.0a NaNdtype: float64In [113]: np.where(pd.isnull(a), b, a)Out[113]: array([ 0. , 2.5, 2. , 3.5, 4.5, nan])

Series有一个combine_first方法,实现的也是一样的功能,还带有pandas的数据对齐:

In [114]: b[:-2].combine_first(a[2:])Out[114]:a NaNb 4.5c 3.0d 2.0e 1.0f 0.0dtype: float64

对于DataFrame,combine_first自然也会在列上做同样的事情,因此你可以将其看做:用传递对象中的数据为调用对象的缺失数据“打补丁”:

In [115]: df1 = pd.DataFrame({'a': [1., np.nan, 5., np.nan],.....: 'b': [np.nan, 2., np.nan, 6.],.....: 'c': range(2, 18, 4)})In [116]: df2 = pd.DataFrame({'a': [5., 4., np.nan, 3., 7.],.....: 'b': [np.nan, 3., 4., 6., 8.]})In [117]: df1Out[117]:a b c0 1.0 NaN 21 NaN 2.0 62 5.0 NaN 103 NaN 6.0 14In [118]: df2Out[118]:a b0 5.0 NaN1 4.0 3.02 NaN 4.03 3.0 6.04 7.0 8.0In [119]: df1.combine_first(df2)Out[119]:a b c0 1.0 NaN 2.01 4.0 2.0 6.02 5.0 4.0 10.03 3.0 6.0 14.04 7.0 8.0 NaN